职场十五年来,我身边通过打工挣到钱的人,屈指可数。其中一例是做到上市公司总裁助理,半年几百万的收入;另一例是公司上市前加入,拿到股份,上市后套现,千万的级别。

其他也有一些销售赚了钱,但规模量级远远不够,比同公司别的岗位略好一些。

从基层员工跨越到高管赚到钱的,也只有一例,凭的是贵人提携。

剩下的有钱人都是自己创业或做生意。

这几天一直深思一个问题,我们打工人在职场中追求的到底是什么?

刚毕业的时候,没系统地想过这个问题。对于没接触过的工作,都有新鲜感,爱觉不累,不断涨经验,凭着热情和责任心,很快做到主管。

中层也容易做到。麻烦的是跳槽的时候不能掉回基层,由俭入奢易,由奢入俭难。再回去做基层的工作,觉得枯燥无味。

有人说怎么可能做到部门经理又去做一般员工呢,这取决于公司规模的大小,有的公司主管就管几十人,有的公司总监也只管二三人。要么跳槽到大公司,职位可能会降低,要么跳到小公司,职位上升但是活儿更杂。

跳槽对于大部分人来说,是随机的事,甚至是件被动的事。能够按照自己明确的目标一家一家跳下去的,少之又少。

等到大小公司都经历过,大部分工作差不多都做过一遍,人生阶段也进入到重负荷的时期。这时才意识到,赚钱是第一位,其它的都是其次。

这时候回想毕业后刚就业时的情怀、信心、责任心、提升经验、积累人脉,都是这些词本身,没有直接地与赚钱联系起来。

等意识到赚钱的第一性后,打工的相对优势开始降低了,后浪们涌了上来,钱少活儿好肯加班,与后浪同地位同起跑线竞争,这是把自己置于了尴尬境地。在以新知识为生产力的行业,更是这样。经验不是优势,反而是阻力和负担。或者说,经验在较低层级的工作领域中,并不能产生明显优势。

总的来说,到了一定年龄,在职场中没站到更高的位置,会很难受。做的和年轻人一样好,人家的性价比更高。做的还没有年轻人好,要你这老年人干嘛?

十五年后回顾职场,得到一个经验,如果下定决心长期在职场发展,就要不断上升,通过攫取权力做到高管,并不断提升人脉质量。只有这样,才能赚到钱,工作也会充满激情,有较强的成就感。

如果不能,自然发展下去,就会是一条下坡路。

不能做到这一点的原因,是没有野心(或志向),性格不适合职场政治。如果确定目标是在职场发展,需要突破这两点。否则,每家公司的高管都是个位数,凭什么是你呢?

好在,职场持续上升,只是个手段,而不是目标,目标是赚到钱。我们付出时间和辛苦,所做的一切,都是为了先实现赚钱这个目标。

凡间的幸福和金钱是密切挂钩的,如果说内心平静才是幸福,那也是你关心的人的愿望大部分实现之后的内心平静。享受过荣华,才有权力享受生活的平淡。除非你是一个人,没有牵挂。

而赚到钱这个目标,以打工人的身份来实现,就像开头所说的,万无一二。哪怕求温饱稳定,也要受很多委屈。

比较好的方式,是毕业后先上几年班,期间全力以赴接受挑战,细心观察揣摩,为以后创业积累经验,包括弄清楚一个公司的管理方式,一个产业行业的利益链条,一个生意的商业模式,以及每项关键业务背后本质的决定因素等。

之后,就专注在自己创业的道路上,拼头脑、体力、资源。即使运气不好,短期内无法实现财务自由,只要坚持长期主义,十年、二十年之后也一定会成为少数有钱人。

周鸿祎、张一鸣都是这样的例子,短暂上班后,开创了自己的事业。身边也有朋友是同样的过程,不过回归的是家族企业。

如果没有那么大的野心和勇气,不求大富大贵,只求安定平稳,就做一份稳定的工作,考公务员、进事业单位和学校,没有那么多不确定性,比不进则退的打工人好很多。

如果有稳定工作的机会,大部分人都应该去选这条路,不仅生活安定,闲暇时间把兴趣爱好结合起来,还能实现更多的可能性。比如《三体》的作者刘慈欣,本职工作是电厂计算机工程师,业余时间写出了中国科幻第一书,他曾经说过,很感谢电厂这份稳定的工作,才让他能有条件写出自己喜欢的内容。

我曾经也有一份稳定的工作机会,但是年轻时没经验,草率地放弃了。

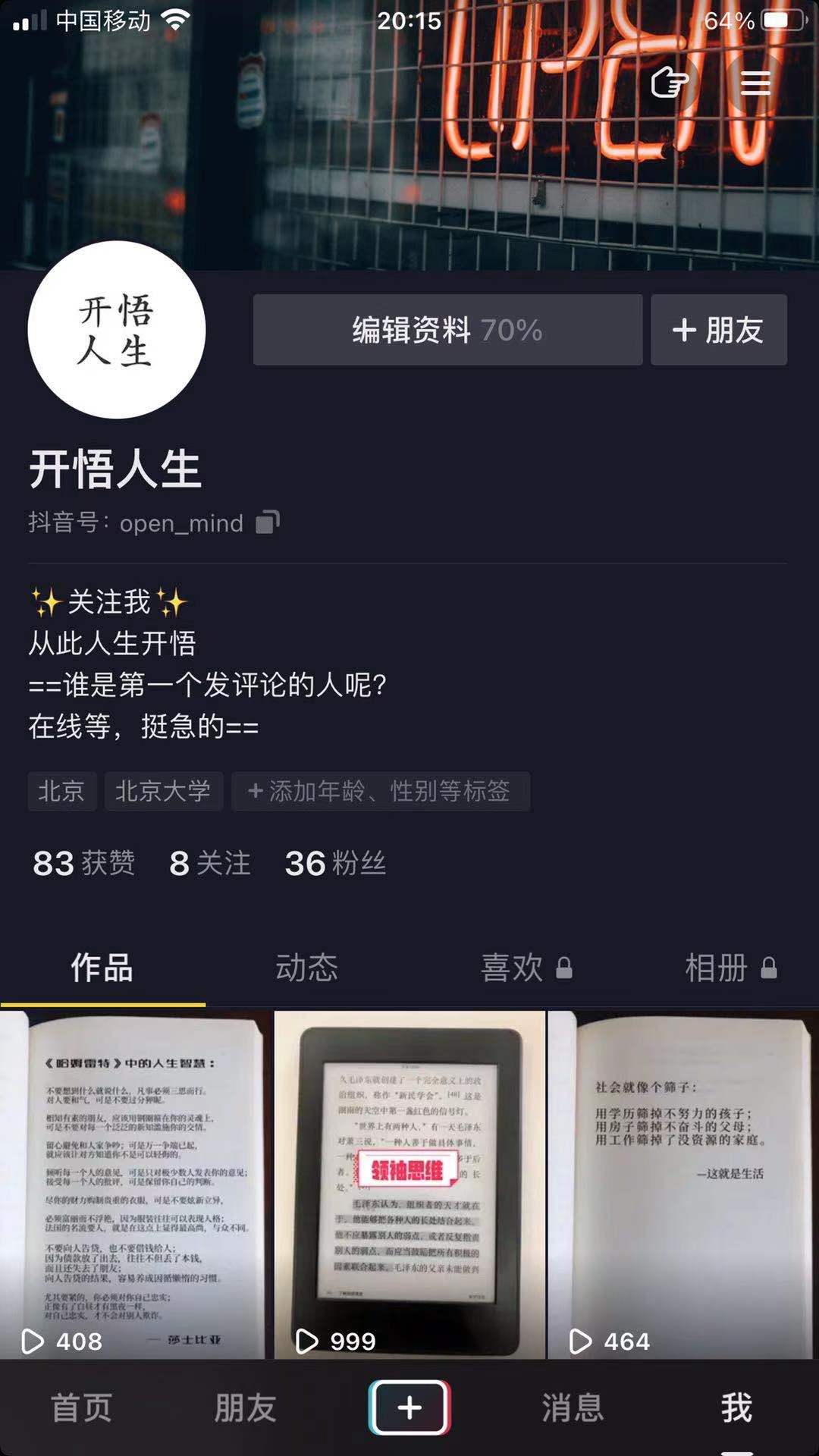

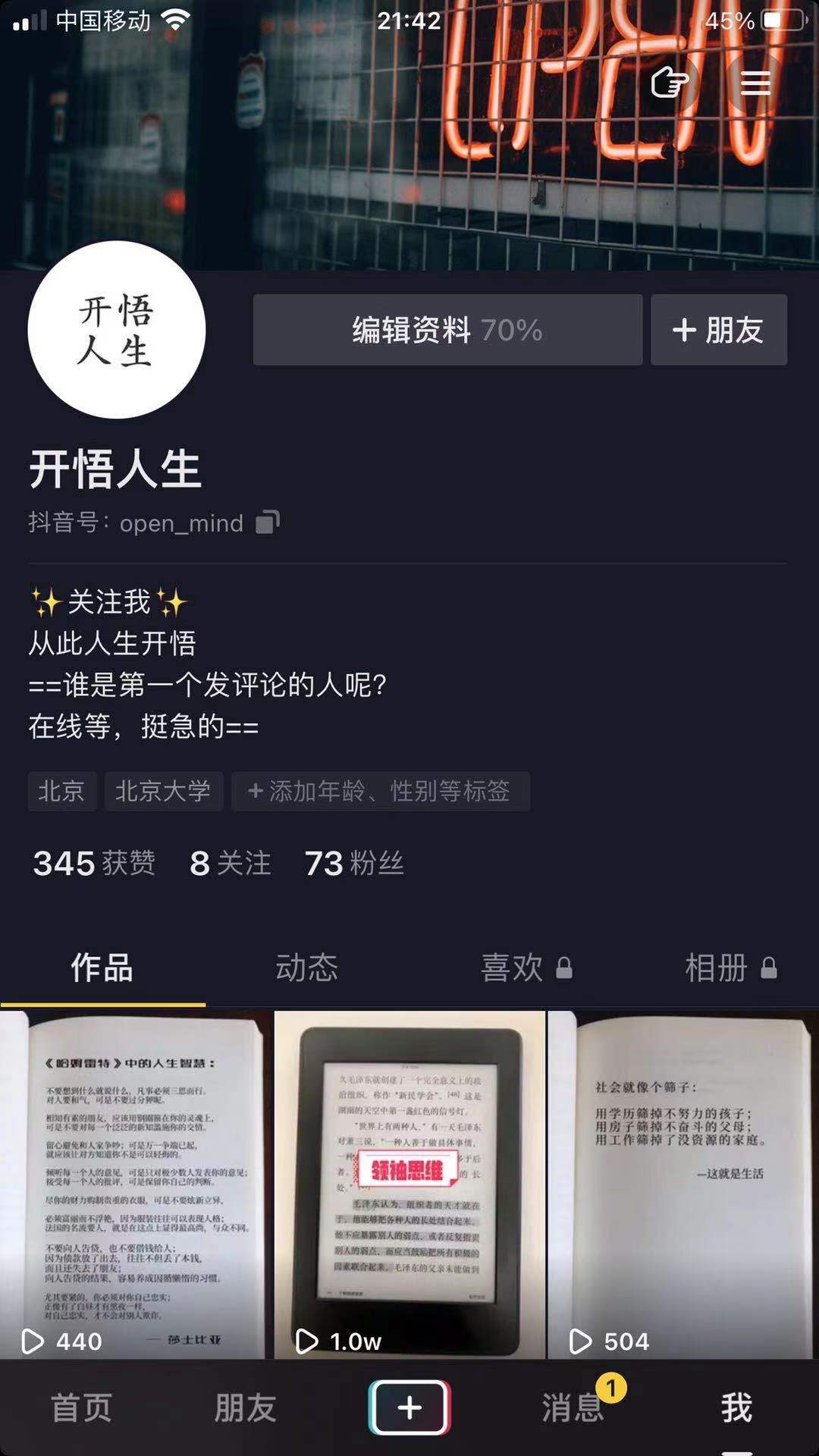

如果已经是打工人,长期身处职场,却还没有上升到高层,也没有上升的意愿、动力和能力,那就找一个相对简单、轻松的环境,尽量保证工作不受人诟病,不多言,不多事。一方面保持生活、工作的平衡,另一方面寻找项目机会,多增加一些收入。更可以坚持做一件有长期价值的事,等待有一天职场无容身之地,没了主要收入,还有被动收入保障生活。

除此之外,没有太多的选择,除非不属于打工人这个阶层。

早些了解清楚自己的优劣势、明确事业目标,确定好自己的定位,利用好业余的时间,构建一个新的收入引擎。如果一直依赖一个出卖时间的主引擎,一旦发生单点故障,风险实在是太高了。